本記事は

技術書著者Week

最終日の記事です。

📕

5日目

▶▶ 本記事

小西秀和です。

今回は当社で書籍を執筆したことがある人がブログ記事を投稿する企画「技術書著者Week」ということで記事を書きました。

はじめに私が今までに執筆してきた本について紹介します。

いずれもAWSについて書いた本で、最近の3冊についてはAWS認定に関する書籍となっています。

このAWS認定に関連する本の中でも私は主に練習問題を作ることが多かったため、今回は仮想試験と題して非常に興味があるけど敷居が高くて触れないAWS Ground Stationについて座学した内容を元に練習問題を作成してみました。

誤解の無いように敢えて書きますが、本記事執筆時点でAWS Ground Stationに関するAWS認定は存在しません。あくまで私が憧れのサービスであるAWS Ground Stationのインプットを練習問題という形でアウトプットしたものになりますのでその点ご承知おきください。

また、実際に受験することになる公式のAWS認定試験の問題はAWS Subject Matter Expert(AWS SME)達によって作成されています。もちろん、私はそのメンバーではないため、私が作成する問題はAWS SMEの試験開発プロセスとは一切関係が無いという点もご認識いただければと思います。

AWSに関する練習問題の作り方

まず、AWSに関する練習問題の作り方について簡単に書いておこうと思います。

前述しましたがAWS Ground Stationは人工衛星をオンボーディングしたり、高額だったりと私個人として実際に使用することが難しいため、今回は次の資料を中心に練習問題を作成しました。

- AWS Documents(AWS Ground Station)

- FAQs(AWS Ground Station)

- AWS Public Sector Blog(Tag: AWS Ground Station)

このうちの「FAQs(よくある質問)」やAWS Ground Stationについては記載が無かったですが「AWS Knowledge Center」といった資料はQ&A形式になっているため、そこから発展させて練習問題を作成しやすいものになります。

またAWS DocumentsやAWS Blogで紹介されているベストプラクティス、トラブルシューティング、アーキテクチャパターンといった各AWSサービス共通で重要になってくるテーマについてはAWSサービスが異なっても練習問題のパターンを再利用することができます。

問題の種類について言うと、AWSサービス単体に着目した問題は、機能、特徴、制限(クォータ等)、権限(IAMロール・ポリシー等)、ユースケース、ベストプラクティス、トラブルシューティング、モニタリング、バックアップ、クロスリージョン利用、クロスアカウント利用といったものが主な題材となります。

複数AWSサービスが関連した問題は、上記のAWSサービス単体に着目した題材を絡めたAWSサービス単体の複数AWSサービスの中における役割、複数AWSサービスで構成するアーキテクチャの最適性(アーキテクチャパターンとしての静的な最適性、時系列処理における動的な最適性)・可用性の向上策・トラブルシューティングなどが主な題材となります。

そして、問題の要件を満たす正解を絞り込むための条件としては、料金、作業量、解決までの時間、ダウンタイム、リアルタイム性などをよく使用します。

AWS Ground Stationの練習問題

それでは早速ですが、AWS Ground Stationの練習問題をOGPのアイキャッチ画像に加えて5問作ってみましたので興味がありましたらチャレンジしてみてください。

主な出題範囲は「AWSに関する練習問題の作り方」で前述した資料になりますので、そちらで学習してから解いていただくとより理解が深まると思います。

問題00

問題00解答:A

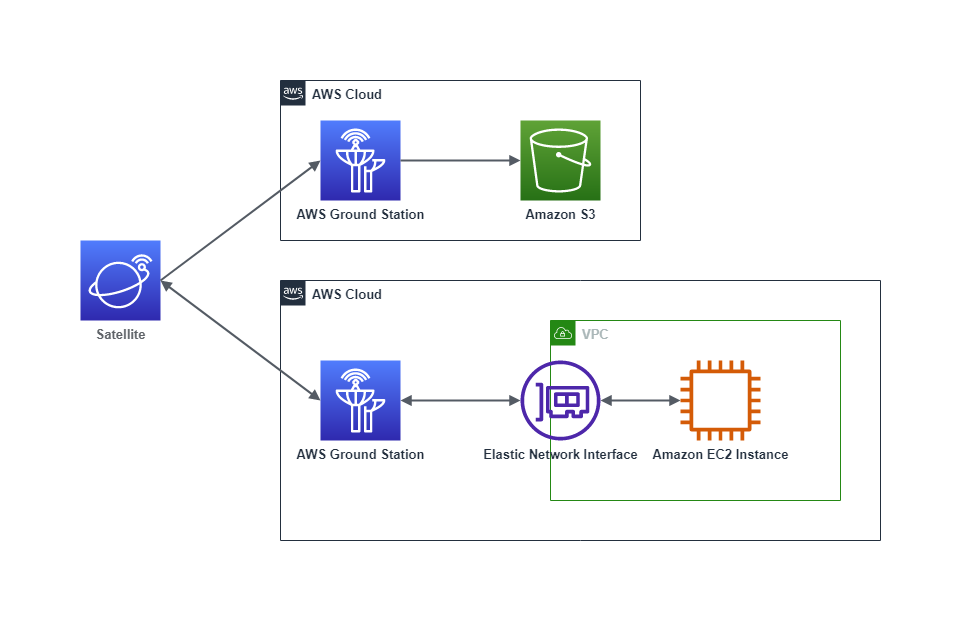

AWS Ground Stationの主な機能は人工衛星からデータを受信する地上局を1分単位で予約利用し、人工衛星データをAmazon S3やAmazon EC2といったAWSサービスに配信することです。

実際にAWS Ground Stationの利用を開始するにはAWS Ground Stationチームに利用に関する詳細内容を連絡して人工衛星をオンボーディングする必要があります。

- (正解):AWS Ground Stationの利用は1分単位でスケジュールでき、支払いはその時間分の課金になります。実際の料金の価格についてはGround Station Pricingを参照してください。

- (不正解):International Space Stationは国際宇宙ステーションのことで主に研究用途で使用される居住可能な人工衛星です。なお、本記事執筆時点ではオンボーディング可能な人工衛星のリストには記載されていません。

- (不正解):Satellite Earth Stationは衛星の地上局のことです。AWS Ground Stationはこの地上局を必要な時間だけ利用できるサービスです。

- (不正解):Radio Communication Stationは電波を介して通信するために必要な機器を備えた一般的な無線通信局のことです。

<参考>

https://docs.aws.amazon.com/ground-station/latest/ug/getting-started.html

https://docs.aws.amazon.com/ground-station/latest/ug/customer-onboarding.html

問題01

米国東部(オハイオ)リージョン(us-east-2)でホストしているAWS Ground Stationから配信されるコンタクトデータを米国西部(オレゴン)リージョン(us-west-2)に保存しようとしています。

この要件を最も少ない作業量、時間、コストで実現する方法はどれですか。

- AWS Ground Stationからコンタクトデータをus-east-2のAmazon S3に配信する。Amazon S3クロスリージョンレプリケーションでus-west-2にコピーする。

- AWS Ground Stationからコンタクトデータをus-east-2のAmazon EC2に関連付けられたAmazon EFSに配信する。Amazon EFSのあるus-east-2のAmazon VPCとus-west-2のAmazon VPCをVPCピアリング接続して、us-west-2のEC2インスタンスからAmazon EFSをマウントする。

- us-east-2のAWS Ground Stationコンソールでコンタクトデータをus-west-2リージョンに配信するように設定しているミッションプロファイルを選択してコンタクト予約をする。

-

AWS CLIの

aws groundstation reserve-contactコマンドで--mission-profile-arnにコンタクトデータをus-west-2リージョンに配信するように設定しているミッションプロファイルARNを指定し、--ground-stationにOregon 1を指定してコンタクト予約をする。

問題01解答:C

AWS Ground Stationから配信されるデータはコンタクトデータと呼ばれ、Amazon S3では非同期で30秒ごとに.pcapファイルとして保存でき、Amazon EC2ではElastic Network Interface(ENI)経由でストリーミング配信による受信および後処理のデータ転送ができます。

本記事執筆時点でAmazon S3へのコンタクトデータのクロスリージョン配信はAWS Ground Stationをサポートしているリージョンで使用でき、Amazon EC2への配信はus-east-2とus-west-2の相互の配信のみがサポートされています。

コンタクトデータのクロスリージョン配信をするにはAWS Ground Stationをホストしてコンソールを使用できるリージョンで、コンタクトデータを配信したいリージョンが設定されたミッションプロファイルを使用してコンタクト予約をします。

- (不正解):実現可能なアーキテクチャですが、双方のリージョンでAmazon S3ストレージ料金がかかり、Amazon S3クロスリージョンレプリケーションの転送料金も発生します。

- (不正解):実現可能なアーキテクチャですが、Amazon EC2のランニングコスト、Amazon S3よりも高額なAmazon EFSのストレージ料金が発生します。また、EC2インスタンスやVPCピアリング等の設定作業も必要です。

- (正解):コンタクトデータのクロスリージョン配信はAWS Ground StationをホストしているリージョンでAWSマネジメントコンソールから設定できます。

-

(不正解):コンタクトデータのクロスリージョン配信はAWS CLIからも可能ですが、この問題の場合は

--ground-stationにはOhio 1を設定する必要があります。AWS CLIのコマンド例は次のようになります。aws groundstation reserve-contact --ground-station 'Ohio 1' --mission-profile-arn '<コンタクトデータを配信したいus-west-2リージョンが設定されたミッションプロファイルARN>' --satellite-arn '<衛星ARN>' --start-time '<開始時間>' --end-time '<終了時間>'

<参考>

https://docs.aws.amazon.com/ground-station/latest/ug/using-cross-region-data-delivery.html

https://docs.aws.amazon.com/ground-station/latest/ug/aws-ground-station-antenna-locations.html

https://docs.aws.amazon.com/ground-station/latest/ug/ground-stations-located-outside-of-aws-regions.html

https://docs.aws.amazon.com/ground-station/latest/ug/contacts-cli.html

問題02

AWS Ground Stationからのコンタクトデータの配信先としてAmazon S3バケットを指定しようとしています。

AWS Ground StationでAmazon S3バケットを使用するために必要な設定はどれですか(3つ選択してください)。

-

Amazon S3バケット名が

aws-groundstationから始まるプレフィックスをもつ。 -

Amazon S3バケットポリシーでAWS Ground Stationの引き受けるIAMロールに対して

s3:GetBucketLocationおよびs3:PutObjectアクションを許可する。 -

Amazon S3バケットポリシーでAWS Ground Stationの引き受けるIAMロールに対して

groundstation:GetConfigおよびgroundstation:UpdateConfigアクションを許可する。 -

AWS Ground Stationの引き受けるIAMロールで

s3.amazonaws.comサービスプリンシパルがロールを引き受けることを許可する信頼ポリシーを設定する。 -

AWS Ground Stationの引き受けるIAMロールで

s3:GetBucketLocationおよびs3:PutObjectアクションを許可するロールポリシーを設定する。 -

AWS Ground Stationの引き受けるIAMロールで

groundstation:GetConfigおよびgroundstation:UpdateConfigアクションを許可するロールポリシーを設定する。

問題02解答:A, B, E

Amazon S3にデータを保存する場合の権限設定には、データを送信する側のIAMロールの信頼ポリシー・ロールポリシーとデータを受信する側のAmazon S3バケットのバケットポリシーが関係します。

AWS Ground StationからAmazon S3バケットにコンタクトデータを送信しようとしているため、AWS Ground Stationが引き受けるIAMロールにAmazon S3バケットへのアクセス権限を付与する必要があります。

必要な権限はS3バケットのロケーション(リージョン)を取得するs3:GetBucketLocationとS3バケットにコンタクトデータのオブジェクトを作成するs3:PutObjectです。

そのため、IAMロールにはs3:GetBucketLocationおよびs3:PutObjectアクションを許可するロールポリシーを設定します。

また、このIAMロールはAWS Ground Stationが引き受けるため、信頼ポリシーではgroundstation.amazonaws.comサービスプリンシパルがロールを引き受けることを許可します。

続いて、コンタクトデータを受信するAmazon S3バケット側ではバケットポリシーでAWS Ground Stationの引き受けるIAMロールに対してs3:GetBucketLocationおよびs3:PutObjectアクションを許可します。

そして、Amazon S3バケット名はAWS Ground Stationの仕様によりaws-groundstationから始まる必要があります。

-

(正解):Amazon S3バケット名はAWS Ground Stationの仕様により

aws-groundstationから始まる必要があります。 -

(正解):Amazon S3バケット側ではバケットポリシーでAWS Ground Stationの引き受けるIAMロールに対して

s3:GetBucketLocationおよびs3:PutObjectアクションを許可します。 -

(不正解):

groundstation:GetConfigおよびgroundstation:UpdateConfigはAWS Ground Stationのアクションであるため、バケットポリシーで許可する必要はありません。 -

(不正解):この問題ではIAMロールを引き受けて使用するのはAWS Ground Stationであるため、信頼ポリシーでは

groundstation.amazonaws.comサービスプリンシパルがロールを引き受けることを許可します。 -

(正解):AWS Ground StationがAmazon S3バケットにコンタクトデータを保存するアクションである

s3:GetBucketLocationとs3:PutObjectをIAMロールポリシーで許可します。 -

(不正解):

groundstation:GetConfigとgroundstation:UpdateConfigはAWS Ground Stationのアクションであるため、Amazon S3バケットにデータを保存する設定とは直接関係しません。

<参考>

https://docs.aws.amazon.com/ground-station/latest/ug/configs.html

問題03

AWS Ground StationからコンタクトデータをAmazon EC2インスタンスにストリーミングするようにセットアップしました。

AWS Ground Stationのコンタクトを開始しましたがステータスがFAILEDになり、コンタクトが正常に完了しませんでした。

この問題の原因として可能性が高いものはどれですか(2つ選択してください)。

- AWS Ground Stationサービスに問題が発生している。

- Amazon EC2インスタンスでData Defenderが実行されていない。

- Amazon EC2インスタンスでData Defender Streamが正しく設定されていない。

- AWS Ground Stationイベントを検知するAmazon EventBridgeルールが正しく設定されていない。

- AWS Ground StationコンタクトデータをキャッシュするAmazon S3が正しく設定されていない。

問題03解答:B, C

AWS Ground StationのコンタクトがFAILEDのステータスで終了する場合は顧客のリソース構成に問題があります。

一方でAWS Ground Stationサービスに問題がある場合はAWS_FAILEDのステータスで終了します。

AWS Ground Stationを使用して衛星との間でデータを送受信するAmazon EC2インスタンスはReceiver Instanceと呼ばれます。

Receiver Instanceでコンタクトデータをストリーミングする場合には衛星との間でデータを送受信するためのエンドポイントを定義するDataflow Endpoint Groupを使用します。

Receiver InstanceはData DefenderというソフトウェアでData Defender Streamを構成することにより、Dataflow Endpoint Groupで定義されたポートを使用してAWS Ground Stationからデータストリームを受信することができます。

そのため、Amazon EC2インスタンスでコンタクトデータをストリーミングするために必要な条件にはData Defender Streamの設定、Data Defenderの実行が含まれます。

問題の選択肢からAmazon EC2インスタンスでコンタクトデータのストリーミングをするのに不要なものを消去法で除外しても正解にたどり着けると思います。

- (不正解):AWS Ground Stationサービスに問題がある場合はAWS_FAILEDのステータスで終了します。

- (正解):Amazon EC2インスタンスでData Defenderが実行されていないことは原因の一つとして可能性があります。

- (正解):Amazon EC2インスタンスでData Defender Streamが正しく設定されていないことは原因の一つとして可能性があります。

- (不正解):Amazon EventBridgeルールはAWS Ground StationやAmazon S3などのイベントを検知して他のAWSサービスと連携する場合に使用します。Amazon EC2インスタンスでコンタクトデータをストリーミングする設定に必須ではありません。

- (不正解):Amazon S3はコンタクトデータをキャッシュする目的で使用されるのではなく、AWS Ground Stationのコンタクトデータを非同期で配信するストレージとして使用されます。また、この問題ではAmazon EC2インスタンスでコンタクトデータをストリーミングするためAmazon S3の使用は必須ではありません。

<参考>

https://docs.aws.amazon.com/ground-station/latest/ug/troubleshooting-contact.html

https://docs.aws.amazon.com/ground-station/latest/ug/contact-statuses.html

https://docs.aws.amazon.com/ground-station/latest/ug/how-ground-station-works.html

https://docs.aws.amazon.com/ground-station/latest/ug/aqua-snpp-jpss.html

https://docs.aws.amazon.com/ground-station/latest/ug/aqua-snpp-jpss-terra-digif.html

問題04

AWS Ground StationからコンタクトデータをAmazon S3に配信し、前処理後の地球観測データ画像を使用した機械学習で農地に不定期で出現する円形模様を検知しようとしています。

最も少ない作業量で要件を満たすことができる方法はどれですか。

- Amazon SageMakerで独自の画像分類アルゴリズムを開発し、既存の航空写真を使用してトレーニングしたモデルを実行する

- Amazon Lookout for Visionのカスタムラベルで既存の航空写真を使用してトレーニングしたモデルを実行する

- Amazon Rekognitionのカスタムラベルで既存の航空写真を使用してトレーニングしたモデルを実行する

- Amazon Kinesis Data Analyticsのカスタムラベルで既存の航空写真を使用してトレーニングしたモデルを実行する

問題04解答:C

この問題はAWS Ground Stationそのものというよりも受信した地球観測データを機械学習で分析する内容の設問です。

問題では画像を使用した機械学習をしようとしているため、画像解析が可能なAWSサービスを選択する必要があります。

選択肢の中では様々な組み込みアルゴリズムや独自アルゴリズムが使用できるAmazon SageMaker、画像と動画の分析を自動化するフルマネージドサービスであるAmazon Rekognitionが候補として挙がります。

問題では最も少ない作業量が要件とされており、独自の画像分類アルゴリズムを開発する作業量が多いAmazon SageMakerは候補からはずれ、フルマネージドサービスであるAmazon Rekognitionが正解となります。

一方でAmazon SageMakerは機械学習モデル開発の全ての工程をサポートするサービスであり、組み込みの画像分類アルゴリズムも使用できます。

そのため、条件に合わせた柔軟なカスタマイズが必要な場合などAmazon SageMakerで組み込みの画像分類アルゴリズムを使用する方法が向いているケースもあります。

- (不正解):独自の画像分類アルゴリズムを開発する作業量が必要となるため、この問題では候補から外れます。

- (不正解):Amazon Lookout for Visionはコンピュータビジョンを利用して、製造された製品の欠陥を大規模なデータセットから発見する機械学習サービスです。

- (正解):Amazon Rekognitionは画像と動画の分析ができる機械学習サービスでカスタムラベルを作成して使用することもできます。

- (不正解):Amazon Kinesis Data AnalyticsはSQLやApache Flinkによるデータストリームのリアルタイム分析を提供するサービスです。

<参考>

https://aws.amazon.com/rekognition/custom-labels-features/

https://aws.amazon.com/blogs/machine-learning/classify-your-own-images-using-amazon-sagemaker/

https://aws.amazon.com/lookout-for-vision/

https://aws.amazon.com/kinesis/data-analytics/

問題05

AWS Ground Stationから配信されるコンタクトデータから対象地域の表面温度画像を取得してモニタリングしようとしています。

コンタクトデータから目的の画像を抽出できる前処理はどれですか。

-

AWS Ground StationがAmazon S3に.pcapファイルを配信したイベントをトリガーにAmazon EventBridgeでAWS Step Functionsステートマシンを実行する。

AWS Step FunctionsステートマシンでAWS Lambda関数、RT-STPS(Real-time Software Telemetry Processing System)用EC2インスタンス、IPOPP(International Planetary Observation Processing Package)用EC2インスタンスの実行を制御する。

Amazon S3バケットを介しながら、AWS Lambda関数による.pcapファイルから生データファイルの取得、RT-STPS用EC2インスタンスによる生データから地球観測データレベルのレベル0データへの変換、IPOPP用EC2インスタンスによるレベル0データからレベル1A、レベル1B、レベル2へのデータ変換を実行し、一連の処理で作成されるファイルをAmazon S3バケットに保存する。

-

AWS Ground StationがAmazon S3に.pcapファイルを配信したイベントをトリガーにAmazon EventBridgeでAmazon CloudFront Functionsランタイムを実行する。

Amazon CloudFront FunctionsランタイムでAWS Lambda関数、RT-STPS(Real-time Software Telemetry Processing System)用EC2インスタンス、IPOPP(International Planetary Observation Processing Package)用EC2インスタンスの実行を制御する。

Amazon S3バケットを介しながら、AWS Lambda関数による.pcapファイルから生データファイルの取得、RT-STPS用EC2インスタンスによる生データから地球観測データレベルのレベル0データへの変換、IPOPP用EC2インスタンスによるレベル0データからレベル1A、レベル1B、レベル2へのデータ変換を実行し、一連の処理で作成されるファイルをAmazon S3バケットに保存する。

-

AWS Ground StationがAmazon EFSに.parquetファイルを配信したイベントをトリガーにAmazon EventBridgeでAWS Step Functionsステートマシンを実行する。

AWS Step FunctionsステートマシンでAWS Lambda関数、RT-STPS(Real-time Software Telemetry Processing System)用EC2インスタンス、IPOPP(International Planetary Observation Processing Package)用EC2インスタンスの実行を制御する。

Amazon EFSを介しながら、AWS Lambda関数による.parquetファイルから生データファイルの取得、RT-STPS用EC2インスタンスによる生データから地球観測データレベルのレベル0データへの変換、IPOPP用EC2インスタンスによるレベル0データからレベル1A、レベル1B、レベル2へのデータ変換を実行し、一連の処理で作成されるファイルをAmazon EFSに保存する。

-

AWS Ground StationがAmazon S3に.parquetファイルを配信したイベントをトリガーにAmazon EventBridgeでAWS Step Functionsステートマシンを実行する。

AWS Step FunctionsステートマシンでAWS Lambda関数、RT-STPS(Real-time Software Telemetry Processing System)用EC2インスタンス、IPOPP(International Planetary Observation Processing Package)用EC2インスタンスの実行を制御する。

Amazon S3バケットを介しながら、AWS Lambda関数による.parquetファイルから生データファイルの取得、RT-STPS用EC2インスタンスによる生データから地球観測データレベルのレベル0データへの変換、IPOPP用EC2インスタンスによるレベル0データからレベル1A、レベル1B、レベル2へのデータ変換を実行し、一連の処理で作成されるファイルをAmazon S3バケットに保存する。

問題05解答:A

AWS Ground Stationから配信されるデータはコンタクトデータと呼ばれ、Amazon S3へ.pcapファイルとして保存する、Amazon EC2へElastic Network Interface(ENI)経由でストリーミングするといった方法で受信できます。

AWS Ground Stationから受信した.pcapファイルからは生データを抽出し、RT-STPS、IPOPPといったNASA Direct Readout Labs softwareを使用して地球観測データ(Earth Observing Data)を目的に応じた各レベルに変換して使用します。

この問題では地球観測データの前処理フローにおけるAWSサービスの知識を確認しているため、地球観測データに関する知識が無くても正解を消去法で導き出せるでしょう。

- (正解):実行可能な前処理です。地球の表面温度画像は地球観測データのレベル2で取得できます。

- (不正解):Amazon CloudFront FunctionsランタイムはAmazon CloudFrontでJava Scriptなどのフロントエンド処理をするCloudFront Functionsの実行環境です。AWS Lambda関数やEC2インスタンスの実行制御をすることはできません。

- (不正解):AWS Ground StationのコンタクトデータはAmazon EFSには直接配信できません。また、Amazon S3では.pcapファイルとして配信されます。

- (不正解):AWS Ground StationのコンタクトデータはAmazon S3では.pcapファイルとして配信されます。.parquetファイルはAWS Glueで変換したり、Amazon Athenaで使用したりするなど主にデータ分析の分野で使用されます。

<参考>

https://docs.aws.amazon.com/ground-station/latest/ug/how-ground-station-works.html

https://aws.amazon.com/blogs/publicsector/automated-earth-observation-aws-ground-station-amazon-s3-data-delivery/

https://aws.amazon.com/blogs/publicsector/earth-observation-using-aws-ground-station/

https://www.earthdata.nasa.gov/engage/open-data-services-and-software/data-information-policy/data-levels

Reasons for Continually Obtaining All AWS Certifications, Study Methods, and Levels of Difficulty

Japan AWS Top Engineer and Japan All AWS Certifications Engineer: Special Award for 6 Consecutive Years and The 6 Growth Principles

Tech Blog with related articles referenced

まとめ

いかがでしたでしょうか。今回は興味はあるけど敷居が高くて個人では使うのが難しいAWS Ground Stationを題材に練習問題を作ってみました。

実はこの練習問題を作るという作業、非常に時間がかかります。

慣れてくるとアイデア自体はすぐに思いつくのですが、それを文章化して問題と解説を作成することが大変なのです。

ただ、AWSは問題にしてみると純粋に面白い題材です。

私は小学校から高校ぐらいまで友人同士でお互いにテスト対策の問題を考えて出し合っていたことがあるのですが、その頃の純粋に問題と解決を楽しむ気持ちは苦しい受験時期を乗り越えるのに案外役に立ったと感じています。

大人になって、その頃の経験を活かせるとすれば、純粋に問題と解決を楽しむ経験を現在目の前にしている課題に取り入れてみることだと考え、そのような要素を意識しながらAWS認定のブログ記事やAWS認定対策本を書いています。

AWS認定は純粋に楽しみながらAWSサービスについて理解できる方法の一つです。

AWS認定は合格すると単純に資格として一定の専門知識を証明するだけではなく、その過程で様々なAWSのサービス、アーキテクチャ、ベストプラクティスを知ることになります。

また、現在はAWS認定対策本も増えてきており、受験に一歩踏み出すきっかけとなる学習リソースが非常に充実してきているため、学習面における受験のハードルは低くなってきているのではないでしょうか。

自分のブログや書籍も多くの人にAWS認定の魅力が伝わり、AWS認定を受験してみようかなと思っていただけるきっかけになればと考えています。

そして、今回のブログ以外にも現在進行中の時間がかかるアウトプットがあるため、そちらにも力を入れないといけないと思っています。

まだ詳細は決まっていませんが、今回のテーマである執筆活動も継続していきたいと思っていますので、機会があればそうしたコンテンツが日の目を見るときが来るかもしれません。

現在、出版されているものも含めて、その際には読んでいただけたら幸いです。

これからAWS認定の取得を予定されている方はAWS認定の学習方法に関するブログ記事も書いていますので参考にしてみてください。